向量定义

向量定义

n个有序的数排到一起就是一个向量

向量定义解析

组成:数字 数的个数:n大于等于1,1个数也是向量,这没错,但在编程代码中会有细分,后面再说 有序:向量的数讲究顺序 定义中就这三点,但在印制到书纸上有不同的写法, 有括号的(),在编程中则是列表[], 这是特定场景下的写法不同,不影响定义三个点

向量要表达的核心内容(仅个人观点,如有雷同,纯属巧合...)

对应解析几何,就是二维平面 向量(x,y) 与原点之间形成一个有向线段,因此,向量的核心要素有两点: 大小,方向 推广到多维以后,这两点也适用,只是不用场景下还有其他的名称, 比如, 形容大小,还可以用 距离,长度,欧氏距离,偏差等等,但还是这个意思, 方向,类似的形容还有夹角,偏差等 在同一维度上,差异只有大小和正反向, 在两个维度上,差异有大小,夹角/方向 在三个维度上,差异的形容,还是大小,夹角/方向,但你能隐隐感觉到,虽同是大小,方向,但与二维平面上的大小与方向有所不同 在n个维度上,差异的形容,还是大小,夹角/方向,这时,你会感觉出大大的不妥,却又不知道该怎么弄... 先存疑...后面再说... 这里个人认为,n维(n>=3)向量的不同,体现在“结构”上,任何一维上的差异,都是整体结构差异某个维度的体现 所以, 向量之间的差异,为其结构上的差异, 跟其他人交流时,还要说大小与方向,因为这只是个人观点,个人在看到向量时,内心的真实看法... 要上来与他人说结构,会让他人一脸迷茫,你在说什么... 这个结构,就是向量的各个维度形成的一个事物,它的现实含义,取决于每个维度的现实意义 2维的结构就是2维平面上的线段, 但要知道,这个线段并没有完全表示出向量的所有信息, 没有方向的线段可以映射出无数个(x,y)这样的2维坐标,可以构成以圆点为中心的一个圆, 圆上的任一点映射出来的(x,y)的长度都是该线段的长 再加上方向,在直角平面坐标系中,长度与方向同时确定,那个该线段就可以唯一确定了 在2维平面上,长度+方向 = 向量 3维的结构就是3维空间中的线段, 4维的结构是什么,本人说不出来,就叫它结构吧,它能100%体现出两个向量之间任何细微的差异 在再高维度的时候, 通常就从组成向量本身的元素,从不同的 单一维度上的数值 及 它们的顺序 去描述向量 所以, 向量的不同,就在于它的结构,在于各个维度之间的差异 大小,方向 是最主要的两个因素 大小与方向不同,两个向量肯定不同, 大小与方向相同,两个向量各个维度上的数值是否相同,这个有待证明,目前本人不确定...

大小与方向相同,两个向量各个维度上的数值是否相同?

个人猜测各个维度上的数值也是相同的,猜测依据如下: 向量在2维平面直接坐标系中,向量确定,那么映射的(x,y)是确定的 到3维,多出来的1维与原2维的任一一维构成的新的一个2维平面上, 它的两个坐标(x,z)是确定的,并且其中一维x的映射与原平面上的x一致,是两个平面垂直相交的公共维度x 平面1(x,y)是定的,其中x定了,导致平面2上(x,z)中的z是确定的, z确定了,就意味着平面3上的(z,y)也是确定的 一旦向量确定了,不管它有多少维,在任一一个2维平面上的投影是确定的,不再变了, 而2维平面上一个确定的线段,对应的是一组确定的坐标, 这里的坐标系,任一维度都垂直于剩下的所有维度,任一平面都垂直于剩下的所有平面, 并且向量在一个平面上分解出来的两个维度上的元素值 中的每个值,都关联着两个相互垂直的平面, 因为两个平面垂直相交,某个元素值既是平面1上其中一个维度的值,也是另外一个平面该维度上的值, 所以向量的大小与方向定了,各个维度上元素也就定了 以上仅是个人猜测,未经严格证明,参考一下就行

向量空间

这个思考的过程,会在脑海中呈现中空间的结构,空间的概念 体会一下 向量是有多个元素组成的,它们相互之间有 “位置”,“顺序” 因有 顺序,所以各个元素之间有了 位置 的不同 因位置不同,所以各个元素之间有了顺序,有了结构... 有人说这就是“道”,本人给它加个定语,静态的道,即规律是不变的... 或者说能被人认识的规律是不变的,变化的规律人认知不到/不全...

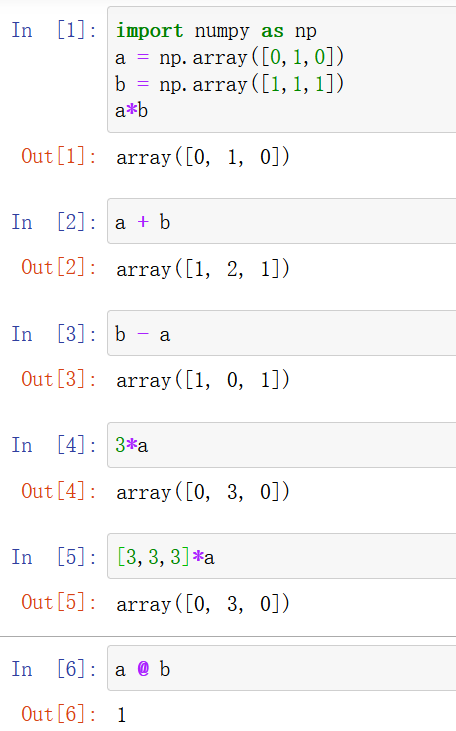

向量加减乘除

向量的矩阵乘法,就是向量内积 在代码计算落地时,没有列向量/列向量这个维度,或者说不管是行向量还是列向量,都按1维列表处理

余弦相似度

n个数排成的线性结构就是向量

向量是n个数组成的线性结构,

向量中每个数称为向量元素,

向量中每个数都存在一个位置,

向量中每个数都存在一个顺序,

向量中每个数都存在一个方向,

向量中每个数都存在一个长度,

向量中每个数都存在一个值,

向量中每个数都存在一个范围

通常谈一个向量,会将这放到对应的向量空间中考虑,

空间会有一个坐标系,常见的为正交直角坐标系

向量的大小与方向,是在定义上推理出来的概念

因为向量不等价于 有大小和方向的事物

大小与方向,是观察/描述向量的两个维度/角度

|

有方向就可以使用cos计算其夹角,夹角越小,向量方向越一致 那么,用cos衡量是否忽略了大小的差异呢? 换句话说,只是方向相同,就可以判断两个事物相同吗? - 这肯定不是 - 那为什么中AI中可以使用cos计算两个向量的差异

cos = (a·b)/(|a|×|b|) = a与b的向量内积/(a的模型×b的模型)

可以看到cos的计算就抹掉了向量的大小,归一,

不管向量原来多大,除以自己的模以后,就归一了

就这使得所有的向量处于同一维度,只看其夹角

或者说,对于一个向量,先归一,再看夹角

|

AI中多是分类问题,比如,区分 苹果,梨,西红柿 向量值大表示大苹果,向量值小表示小苹果 但物体的大小并不是AI分类的任务, 不管是小苹果,还是大苹果,都是苹果,不是梨,也不是西红柿 因为让所有向量除以自己的模,归一 然后求其夹角, 相近的必定在近似在一条直线上 或一个方向 所以,只要求出两个向量的夹角, 就能知道相似度了 |

|

|

|

|

参考